350名專家聯(lián)署警告 人工智能可能滅絕人類

來自全球的350位人工智能專家聯(lián)合發(fā)表公開信,對人工智能技術(shù)可能帶來的滅絕人類風險發(fā)出嚴厲警告。這封聯(lián)署信強調(diào)了人工智能應用軟件開發(fā)的快速發(fā)展,雖然推動了社會進步,但也帶來前所未有的潛在威脅。

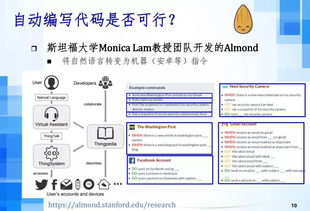

專家們指出,隨著AI系統(tǒng)能力的不斷增強,它們可能在決策、軍事應用、網(wǎng)絡安全等領(lǐng)域超越人類控制。例如,自主武器系統(tǒng)可能被誤用或濫用,導致大規(guī)模沖突;而高度智能的AI若與惡意目標結(jié)合,可能引發(fā)全球性災難。AI的不可預測性和“黑箱”特性,使得人類難以完全理解其決策邏輯,從而增加了失控風險。

在應用軟件開發(fā)方面,專家呼吁加強國際合作和監(jiān)管框架,確保AI技術(shù)的發(fā)展符合倫理準則。他們建議采取預防性措施,如設置安全閾值、進行風險評估和建立應急機制,以防止AI系統(tǒng)對人類生存構(gòu)成威脅。公眾教育也至關(guān)重要,以提高對AI潛在風險的認識。

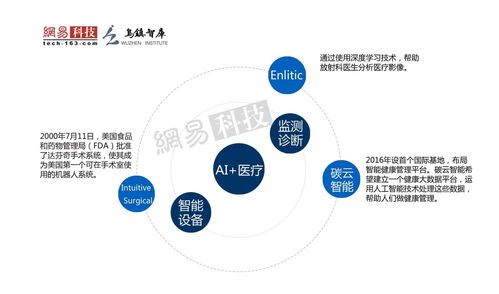

盡管AI在醫(yī)療、交通和環(huán)保等領(lǐng)域帶來了巨大好處,但專家們強調(diào),必須平衡創(chuàng)新與安全。他們敦促政府、企業(yè)和研究機構(gòu)共同努力,推動負責任的人工智能開發(fā),確保技術(shù)服務于人類福祉,而非成為滅絕的導火索。

如若轉(zhuǎn)載,請注明出處:http://m.carabiners.cn/product/27.html

更新時間:2026-05-08 01:39:26